High Bandwidth Flash: la NAND può finalmente comportarsi come memoria?

L’infrastruttura AI ha un modo tutto suo di mettere in luce limiti che la maggior parte dei sistemi non incontra mai.

Negli articoli precedenti abbiamo visto come la high bandwidth memory per i carichi di lavoro AI mantenga i dati il più vicino possibile alla GPU, e come la storage class memory tra DRAM e NAND aiuti a rendere più fluido il divario tra la memoria attiva e il tradizionale storage flash. Entrambi questi livelli esistono perché il sistema non può permettersi di aspettare, nemmeno per brevi periodi di tempo, senza perdere efficienza.

Ma c’è un’altra direzione verso cui l’industria si sta muovendo, e non riguarda l’introduzione di un tipo di memoria completamente nuovo.

Si tratta invece di prendere qualcosa che già esiste, la NAND flash, e spingerla in un ruolo per cui in origine non era stata progettata.

Ed è proprio qui che l’idea della High Bandwidth Flash comincia a entrare nella conversazione.

Il problema che la NAND non è mai stata pensata per risolvere

La NAND flash è sempre stata costruita attorno a un’idea semplice: archiviare grandi quantità di dati in modo efficiente e recuperarli quando servono.

Per la maggior parte dei carichi di lavoro, questo modello funziona perfettamente. I dati restano nello storage, il sistema li richiede e l’SSD li consegna abbastanza velocemente da far sì che quasi nessuno si accorga del ritardo.

I carichi di lavoro AI cambiano questa dinamica.

Invece di letture e scritture occasionali, questi sistemi continuano a tirare dentro dati in parallelo, spesso attraverso migliaia di thread, con pochissima tolleranza verso qualunque incoerenza nella consegna. Non si tratta solo di velocità presa da sola, ma di mantenere un flusso costante di dati che tenga il lato computazionale sempre pienamente utilizzato.

È qui che il comportamento tradizionale della NAND comincia a mostrare i suoi limiti.

Anche le unità NVMe ad alte prestazioni, con code profonde e numeri di throughput molto forti, operano ancora all’interno di un modello di storage che presume raffiche di attività, non un flusso continuo di accesso simile alla memoria.

Quindi la domanda diventa: cosa succede se smetti di trattare la NAND come storage e inizi a trattarla più come parte del sistema di memoria?

Cosa significa davvero “High Bandwidth Flash”

High Bandwidth Flash non è uno standard formale né una singola categoria di prodotto.

È meglio intenderla come una direzione architetturale, ed è proprio qui che comincia a distinguersi da ciò che abbiamo trattato parlando di High Bandwidth Memory.

La High Bandwidth Memory è ancora memoria. È DRAM, costruita e posizionata per offrire un accesso estremamente rapido stando fisicamente vicino al processore. L’intero scopo dell’HBM è la prossimità e la riduzione della latenza, portare i dati il più vicino possibile al compute in modo che possano essere accessibili quasi istantaneamente.

La High Bandwidth Flash risolve un problema diverso. Accetta che la NAND si trovi più lontano nel sistema e porti con sé una latenza più elevata, e si concentra invece su come spostare quantità molto più grandi di dati in parallelo in modo che quella distanza pesi meno.

In termini semplici, l’HBM riguarda il rendere la memoria più veloce avvicinandola. La High Bandwidth Flash riguarda il far comportare lo storage in modo più veloce cambiando il modo in cui vi si accede.

Questa distinzione conta, perché l’obiettivo qui non è trasformare la NAND in DRAM. È rendere la NAND utile in situazioni in cui lo storage tradizionale altrimenti rallenterebbe il sistema.

Il cambiamento avviene a livello di sistema, non solo a livello del supporto.

Invece di un singolo SSD che gestisce le richieste nel modo tradizionale, si inizia a vedere molti canali NAND operare in parallelo, controller progettati per la concorrenza più che per la sola capacità, percorsi dati più ampi attraverso interfacce PCIe Gen5 e Gen6, e livelli software che anticipano e preparano i dati prima ancora che vengano richiesti.

Presi insieme, questi cambiamenti non eliminano la latenza intrinseca della NAND, ma riducono la frequenza con cui quella latenza diventa il fattore limitante del sistema.

Un modo diverso di pensare alla larghezza di banda

Quando si sente dire “alta larghezza di banda”, di solito si pensa subito alla velocità pura.

Ma in questo contesto, la larghezza di banda riguarda davvero quanta quantità di dati può essere spostata in una sola volta, e quanto costantemente quel movimento può essere mantenuto.

I carichi di lavoro AI non hanno bisogno solo di accesso rapido, ma di accesso prevedibile su larga scala.

Se un cluster di GPU tira fuori i dati in modo irregolare, anche piccole variazioni possono causare lo stallo di alcune parti del sistema. Moltiplica questo problema su centinaia o migliaia di nodi, e queste inefficienze iniziano a manifestarsi in modi difficili da ignorare.

La High Bandwidth Flash è un tentativo di rendere tutto questo più uniforme, non eliminando le caratteristiche della NAND, ma circondandola con abbastanza parallelismo e abbastanza intelligenza da far sì che quelle caratteristiche pesino meno sul sistema nel suo complesso.

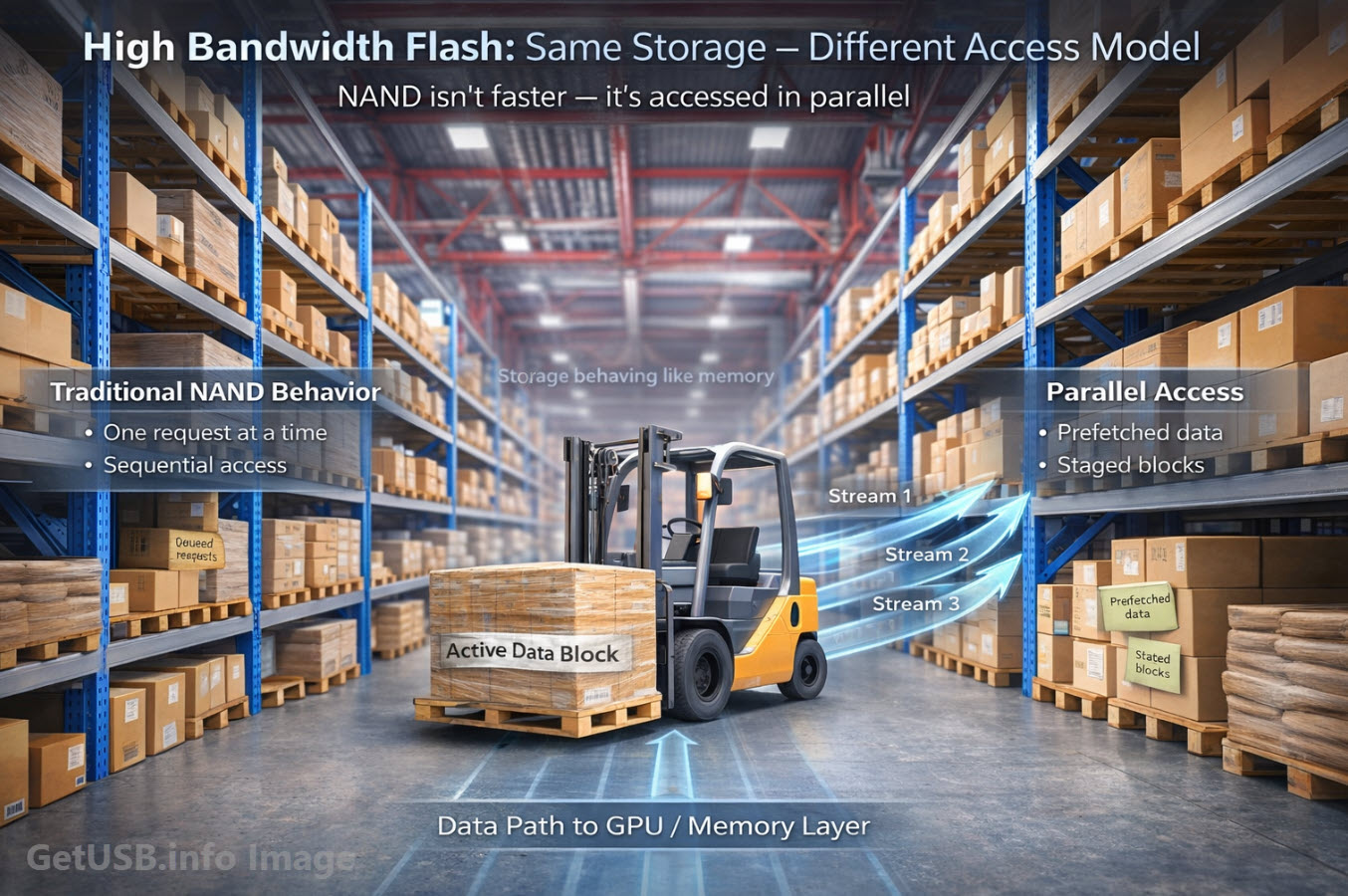

Estendere l’analogia del magazzino

Se continuiamo a usare lo stesso modello del magazzino degli articoli precedenti, la NAND è sempre stata il piano principale di stoccaggio.

È il luogo dove si trova tutto, organizzato in file e scaffali, ottimizzato per densità ed efficienza più che per velocità di accesso.

La DRAM è la banchina di carico, dove avviene il lavoro attivo. La SCM è l’area di preparazione appena dietro.

La High Bandwidth Flash cambia il modo in cui il magazzino funziona.

Invece di un solo lavoratore che entra nei corridoi per prendere gli articoli uno alla volta, ora hai più banchine di carico aperte contemporaneamente, con diversi muletti che si muovono in parallelo, e articoli pre-posizionati in base a ciò che il sistema si aspetta di dover usare subito dopo.

Il magazzino non è cambiato in modo fondamentale, ma è cambiato il modo in cui vi si accede.

Non stai trasformando il magazzino nella banchina di carico, stai facendo in modo che il magazzino si comporti come se fosse molto più vicino a essa.

Come viene costruita nella pratica

La maggior parte di ciò che rende possibile la High Bandwidth Flash non arriva dalla NAND stessa, ma dai livelli che la circondano.

I controller oggi giocano un ruolo più importante nel modo in cui i dati vengono distribuiti, concentrandosi sulle operazioni parallele su più die e canali NAND invece di limitarsi a gestire capacità e usura. Allo stesso tempo, la larghezza di banda delle interfacce continua ad aumentare, dando a questi sistemi più spazio per muovere dati senza essere limitati dal bus.

Ciò che fa davvero la differenza più grande, però, è il modo in cui il software interagisce con l’hardware.

I dati non vengono più semplicemente recuperati quando vengono richiesti. Vengono previsti, preparati, messi in cache e organizzati in modi che si allineano al comportamento dei carichi di lavoro AI. Questo significa anticipare i modelli di accesso, mantenere i dati usati più spesso più vicini alla parte alta dello stack e ridurre al minimo la frequenza con cui il sistema deve ricadere su percorsi più lenti.

Niente di tutto questo trasforma la NAND in vera memoria, ma le permette di partecipare al sistema di memoria in modo più attivo rispetto a prima.

Quello che ancora non è

Con tutti questi progressi, è importante tenere le aspettative con i piedi per terra.

La High Bandwidth Flash non rende la NAND equivalente alla DRAM. Rimane basata su blocchi, continua ad avere una latenza più alta rispetto a qualsiasi forma di vera memoria e continua a dipendere fortemente da controller e software per funzionare bene in ambienti impegnativi.

Questi vincoli non scompaiono, vengono semplicemente gestiti in modo più efficace attraverso la progettazione del sistema.

Dove si inserisce nell’infrastruttura AI

Nelle implementazioni reali, la High Bandwidth Flash sta comparendo in sistemi che devono gestire dataset estremamente grandi senza spingere tutto dentro livelli di memoria molto costosi.

Quello che questo significa davvero, in pratica, è un sistema che si appoggia alla NAND in modo più attivo rispetto a prima, non solo come luogo in cui i dati vengono conservati, ma come parte del percorso dati operativo che alimenta le risorse di calcolo in modo più continuo.

Negli ambienti di inferenza su larga scala, per esempio, modelli e dati di contesto spesso superano ciò che può realisticamente entrare nella DRAM. Invece di forzare tutto dentro la memoria, il sistema si affida a un accesso alla NAND ad alto throughput, consentendo ai dati di fluire abbastanza velocemente da comportarsi più come un’estensione della memoria che come storage tradizionale.

Negli ambienti di training, dove i dataset vengono continuamente rivisitati e processati in parallelo, l’obiettivo si sposta verso il mantenimento di un flusso costante piuttosto che verso la gestione di raffiche isolate. La High Bandwidth Flash supporta questo approccio mantenendo attivi più percorsi dati allo stesso tempo, riducendo la probabilità che una singola richiesta diventi un collo di bottiglia.

Anche nei sistemi distribuiti basati su NVMe fabric, l’idea resta la stessa. I dati sono distribuiti su molti dispositivi e nodi, ma vengono accessi in modo coordinato, con un’enfasi su throughput e disponibilità più che sulla semplice capacità di archiviazione. La NAND continua a svolgere lo stesso lavoro fondamentale, ma il modo in cui il sistema interagisce con essa è molto più dinamico di quanto non fosse un tempo.

Il risultato finale è che la NAND smette di comportarsi come un livello distante in fondo allo stack e comincia a sembrare parte del sistema attivo, anche se non raggiunge mai del tutto le caratteristiche prestazionali della memoria.

Perché questa direzione conta

Se fai un passo indietro e guardi a quello che sta succedendo in tutti e tre questi articoli, inizia a emergere uno schema.

L’HBM avvicina la memoria al compute. La SCM riduce il divario tra memoria e storage. La High Bandwidth Flash spinge lo storage più vicino alla memoria.

Tutto sta convergendo verso lo stesso obiettivo: ridurre quanto lontano devono viaggiare i dati e quanto a lungo il sistema deve aspettarli.

Tornando al quadro più ampio

La NAND non sta scomparendo.

Semmai, sta diventando ancora più importante, perché la quantità totale di dati di cui questi sistemi hanno bisogno continua a crescere.

Quello che sta cambiando è il modo in cui la NAND viene usata.

Non è più soltanto un livello passivo in fondo allo stack. Viene tirata verso l’alto, integrata più strettamente e spinta a comportarsi in modi che assomigliano sempre di più alla memoria, anche se non lo diventerà mai del tutto.

Questo cambiamento è esattamente ciò che avevamo indicato nell’articolo originale: l’industria non ha sostituito la NAND, ci ha costruito attorno.

Cosa viene dopo

Da qui in avanti, lo stack continua a evolversi in entrambe le direzioni.

Sopra, la memoria diventa più veloce e più specializzata. Sotto, lo storage diventa più intelligente e più integrato. E da qualche parte nel mezzo, la linea che separa i due continua a diventare sempre più difficile da definire.

Nel prossimo articolo vedremo come i sistemi AI gestiscono i dati operativi in tempo reale e perché concetti come contesto e KV cache stanno iniziando a influenzare il modo in cui memoria e storage vengono progettati insieme.

Nota editoriale

La prospettiva, la direzione e l’impostazione tecnica di questo articolo sono state guidate dall’autore, sulla base dei temi specifici esplorati nel corso del pezzo e della discussione più ampia su come la NAND venga spinta più vicino al livello della memoria nell’infrastruttura AI.

L’AI è stata usata come assistente di stesura per aiutare con il ritmo, il flusso delle frasi e l’organizzazione strutturale, ma la direzione del tema, i confronti e l’intento editoriale finale sono stati determinati dall’autore.

Anche l’immagine di accompagnamento è stata creata con l’AI, non come una generica visuale stock, ma come un’illustrazione costruita appositamente per riflettere concetti specifici dell’articolo che sono difficili da comunicare con immagini convenzionali – in particolare l’idea della NAND flash che si comporta più come un livello attivo, adiacente alla memoria, all’interno di una moderna architettura dei dati.

Tutti i contenuti sono stati revisionati, rifiniti e approvati dall’autore prima della pubblicazione.