I sistemi di intelligenza artificiale non rallentano generalmente a causa dei limiti di calcolo, ma piuttosto perché il sistema non riesce a spostare i dati abbastanza velocemente da mantenere il processore costantemente alimentato di informazioni.

In altre parole, il collo di bottiglia non è la capacità di elaborare i dati, ma la capacità di fornire quei dati alla velocità richiesta dai carichi di lavoro moderni dell’AI.

È qui che la High Bandwidth Memory (HBM) diventa una parte importante dell’architettura.

Per una visione più ampia su come la memoria stia evolvendo oltre il flash e perché i sistemi AI oggi dipendono da più livelli, consulta la nostra analisi principale: Il NAND non sta scomparendo, ma i server AI oggi dipendono da più del semplice flash.

Cos’è la High Bandwidth Memory (HBM)?

La High Bandwidth Memory è un tipo di DRAM impilata che viene posizionata estremamente vicino al processore, spesso a pochi millimetri dal die della GPU, per ridurre al minimo la distanza fisica che i dati devono percorrere.

A differenza della memoria di sistema tradizionale, che si basa su percorsi elettrici più lunghi e canali dati più stretti, HBM è progettata attorno ai concetti di prossimità e parallelismo, permettendo di trasferire una quantità significativamente maggiore di dati contemporaneamente e con molta meno latenza.

- Bus di memoria molto ampi, spesso larghi migliaia di bit

- Distanze di collegamento estremamente ridotte tra memoria e processore

- Accesso ai dati altamente parallelo

L’obiettivo è semplice: ridurre la distanza tra il punto in cui i dati sono memorizzati e quello in cui vengono elaborati, perché nei sistemi ad alte prestazioni anche piccoli ritardi si accumulano rapidamente.

In termini pratici, la distanza si traduce direttamente in latenza, e la latenza è uno dei principali fattori che limitano le prestazioni dell’intelligenza artificiale.

Un modo semplice per immaginare l’HBM

Un modo utile per visualizzare il concetto è pensare a un sistema tradizionale come a una fabbrica collegata a un magazzino tramite un’autostrada.

Ogni volta che la fabbrica ha bisogno di componenti, questi devono essere trasportati avanti e indietro, introducendo ritardi, aumentando il consumo energetico e limitando la velocità operativa complessiva.

HBM cambia completamente questa relazione impilando, di fatto, il magazzino direttamente sopra il piano della fabbrica.

Invece di dipendere dal trasporto, tutto è immediatamente accessibile, eliminando i ritardi associati allo spostamento dei dati su lunghe distanze.

Questo è esattamente ciò che fa HBM per una GPU, posizionando la memoria così vicino al motore di calcolo che il movimento dei dati diventa quasi istantaneo rispetto ai design tradizionali.

Come è costruita fisicamente l’HBM

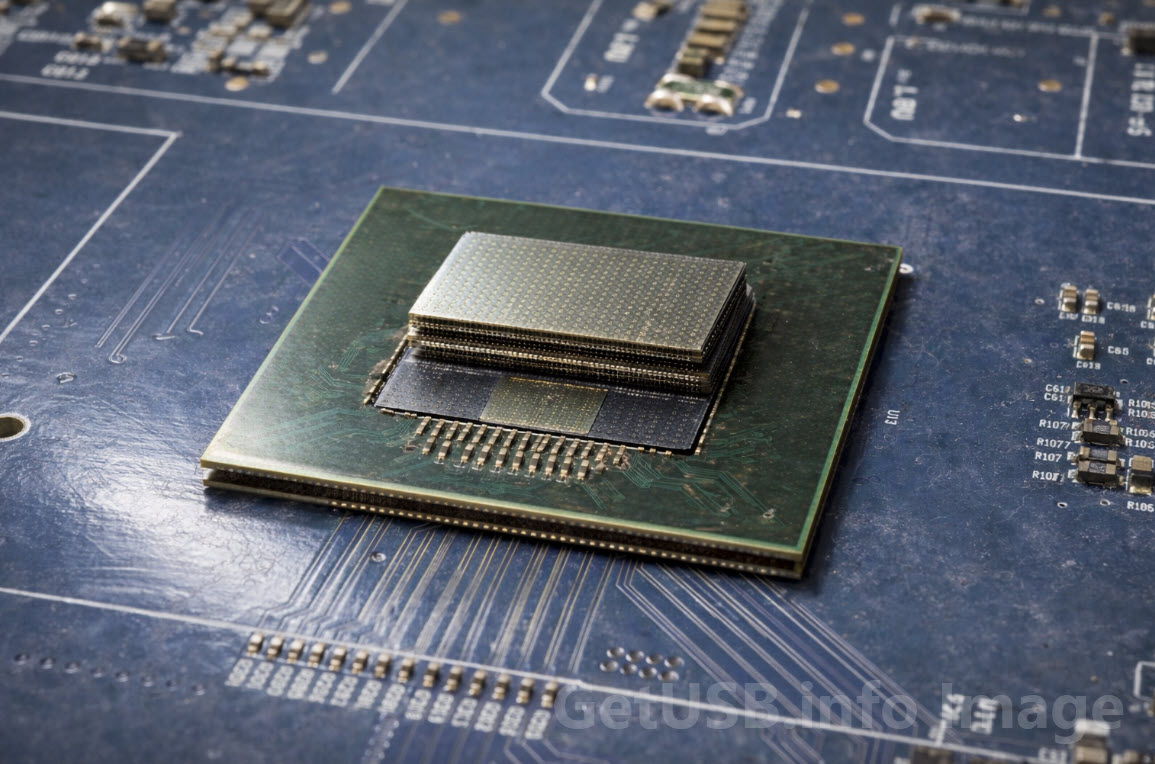

Il vantaggio dell’HBM non risiede solo nel layout, ma anche nel modo in cui la memoria è costruita a livello di silicio.

HBM viene realizzata impilando verticalmente più die DRAM e collegandoli tramite Through-Silicon Vias (TSV), ovvero minuscoli percorsi verticali scavati nel silicio che permettono connessioni elettriche dirette tra gli strati.

Questi moduli di memoria impilati vengono poi montati su un interposer insieme alla GPU, formando un pacchetto altamente integrato in cui memoria e calcolo operano come un sistema unificato anziché come componenti separati.

Il risultato è una combinazione di percorsi dati estremamente ampi e distanze elettriche molto brevi, che insieme consentono l’elevata larghezza di banda che caratterizza l’HBM.

Perché l’AI dipende dall’HBM

I carichi di lavoro dell’AI, in particolare durante l’addestramento dei modelli, richiedono un movimento continuo di grandi quantità di dati, spesso con miliardi o addirittura trilioni di parametri che devono essere letti, aggiornati e riscritti ripetutamente.

Questo crea una richiesta simultanea di alta larghezza di banda, per spostare rapidamente grandi dataset, e bassa latenza, per garantire che le unità di calcolo non rimangano inattive in attesa dei dati.

- L’elevata larghezza di banda consente il trasferimento rapido di grandi volumi di dati

- La bassa latenza garantisce che le unità di calcolo rimangano completamente utilizzate

Le architetture di memoria tradizionali faticano a soddisfare entrambe queste esigenze contemporaneamente, motivo per cui l’HBM è diventata un componente standard negli acceleratori AI di fascia alta.

Senza HBM, anche la GPU più potente trascorrerebbe una parte significativa del tempo ad aspettare i dati invece di elaborarli.

Il compromesso: velocità vs costo

Sebbene l’HBM offra notevoli vantaggi in termini di prestazioni, introduce anche maggiore complessità e costi più elevati a causa del suo design impilato e dei requisiti avanzati di packaging.

L’uso di più strati di DRAM, interconnessioni di precisione e integrazione tramite interposer rende l’HBM una delle tecnologie di memoria più costose attualmente disponibili.

Per questo motivo, viene generalmente utilizzata in applicazioni dove le prestazioni sono critiche e il costo può essere giustificato, come l’addestramento AI e gli ambienti di high-performance computing.

I sistemi general-purpose, dove la sensibilità al costo è maggiore, continuano a utilizzare soluzioni di memoria più convenzionali.

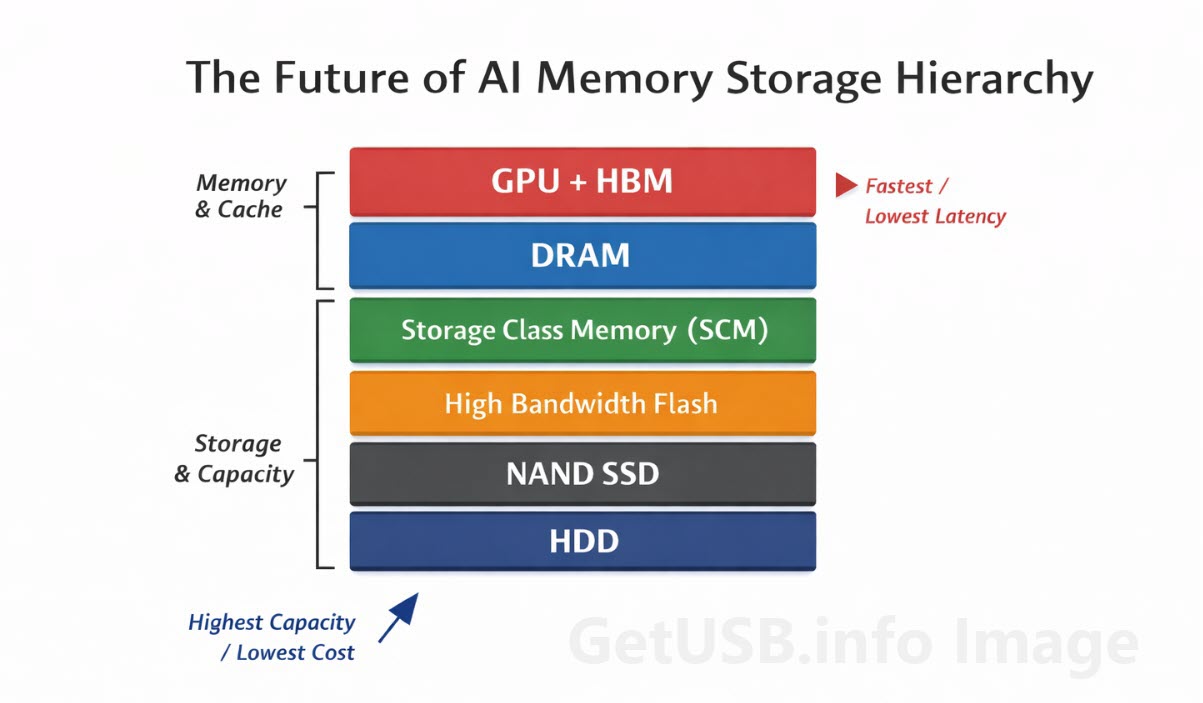

Dove si colloca l’HBM nel quadro generale

L’HBM non sostituisce gli altri tipi di memoria, ma si posiziona al vertice di una gerarchia multilivello, in cui ogni livello è ottimizzato per un diverso equilibrio tra velocità, costo e capacità.

| Tecnologia | Latenza tipica | Larghezza di banda | Costo per GB | Ruolo principale |

|---|---|---|---|---|

| HBM (DRAM impilata) | Nanosecondi | Terabyte/sec | Molto alto | Memoria per training AI |

| DDR DRAM | ~100ns | Alta | Alta | Memoria di sistema |

| NVMe SSD | Microsecondi–Millisecondi | Moderata | Basso | Archiviazione dati |

Ogni livello esiste a causa dei compromessi tra prestazioni, costo e capacità, e nessuna singola tecnologia può ottimizzare tutti e tre questi fattori contemporaneamente.

L’HBM occupa il livello più alto in termini di prestazioni, dove la velocità ha la priorità sul costo, rendendola essenziale per i carichi di lavoro che non possono tollerare ritardi.

Il cambiamento

L’HBM non dovrebbe essere considerata semplicemente come una memoria più veloce, ma come un cambiamento nel design dei sistemi che avvicina fisicamente la memoria al calcolo per eliminare uno dei principali colli di bottiglia dell’informatica moderna.

Nei sistemi AI, dove le prestazioni sono direttamente legate alla velocità con cui i dati possono essere accessibili ed elaborati, questo cambiamento architetturale svolge un ruolo fondamentale.

In definitiva, anche i processori più avanzati dipendono da un flusso costante di dati, ed è proprio il miglioramento di questo flusso che rende tecnologie come l’HBM così importanti.

Nota editoriale e sull’immagine: Questo articolo è stato sviluppato e revisionato da GetUSB.info sulla base della nostra ricerca editoriale e della nostra comprensione tecnica del packaging della memoria e dell’hardware di archiviazione.

Nota sull’immagine: L’immagine utilizzata in questo articolo si basa su una fotografia reale di un chip ed è stata migliorata per illustrare meglio il concetto di HBM ai lettori. Il miglioramento è stato effettuato esclusivamente a scopo esplicativo, quindi l’immagine deve essere interpretata come una rappresentazione realistica ma illustrativa, non come una foto di riferimento di produzione.

Come è stato creato questo articolo: GetUSB.info ha fornito la direzione del contenuto, l’angolo tecnico e la revisione finale. Sono stati utilizzati strumenti AI per supportare ritmo e flusso, con supervisione umana applicata durante tutto il processo.